Pop-up archiefvideo

Het efficiënter beschikbaar en doorzoekbaar maken van grote videoarchieven is al jaren onderwerp van intensief onderzoek in diverse nationale en internationale projecten. Het AXES project dat eind maart 2015 werd afgerond, leverde een belangrijke bijdrage aan dit onderzoek door de technologie voor het analyseren en doorzoeken van video’s een forse stap verder vooruit te brengen en tegelijkertijd goed te kijken naar de gebruikerswensen van diverse gebruikersgroepen die geïnteresseerd zijn in videoarchieven. Denk aan producenten en journalisten die videomateriaal willen hergebruiken voor nieuwe producties, onderzoekers die kennis willen opdoen door (grote hoeveelheden) video te analyseren, of ‘de thuisgebruiker’ die uit is op ‘infotainment’ en op een toegankelijke en speelse manier informatie wil opdoen of gewoon een leuk filmpje wil kijken. Met name voor deze laatste groep, die niet altijd meer achter een PC zit, maar op de bank, in de tuin of in de trein met een tablet op schoot, heeft AXES nieuwe concepten ontwikkeld om interessante video’s uit het archief naar boven te halen en naar de gebruiker toe te brengen. Hieronder een kort verslag van deze nieuwe concepten.

Twee achterliggende gedachten spelen een rol bij het ontwikkelen van nieuwe concepten om video’s uit het archief naar boven te halen en naar de gebruiker toe te brengen. Ten eerste, gebruikers zijn lastig te porren om naar een zoekportal ergens op het web toe te komen. Gebruikers zitten al ergens op het web, vertonen daar zeer vluchtig gedrag, en verwachten eigenlijk dat de content wel naar hen toekomt, in plaats van andersom. Ten tweede, thuisgebruikers hebben vaak geen idee wat zich in videoarchieven bevindt en vinden het lastig om goede zoektermen te bedenken die voor hen interessante video’s naar boven zouden kunnen brengen. Gebruikers hier wat hulp bij bieden is nuttig want stelt hen in staat om beter de rijkdom van grote videoarchieven te benutten. Het Beeld & Geluid archief bijvoorbeeld, bevat honderdduizenden uren Nederlands beeldmateriaal van de afgelopen honderd jaar waar ongetwijfeld voor iedere gebruiker wat wils in is te vinden.

Beeldbrowsen

In het ‘AXES-HOME’ zoeksysteem, speciaal ontwikkeld voor de thuisgebruiker met een tablet op schoot, wordt met deze gedachten geëxperimenteerd door de beschikbare zoektechnologie op bijzondere manieren in te zetten. Een voorbeeld hiervan is het gebruik van Google’s ‘I’m feeling lucky’ concept. Met een druk op de knop –of door het schudden van de tablet– worden ‘random’ voorkomens in de data van honderden automatisch herkende beeldconcepten zoals ‘microfoon’, ‘teek’, ‘kikker’ of ‘diner’ aan de gebruiker voorschotelt. Het idee hierachter is dat het de gebruiker uitnodigt om op een andere manier door een videoarchief te navigeren en zo op onvermoede pareltjes te stuiten. Tijdens gebruikersevaluaties waren gebruikers erg enthousiast over deze toepassing en onder de indruk van de hoge kwaliteit van de beeldherkenningstechnologie.

Outside-in linking

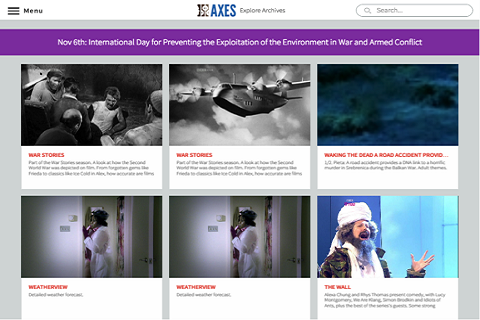

Een ander voorbeeld van het op een alternatieve manier inzetten van zoektechnologie die aansluit bij online gebruikers is het concept ‘outside-in linking’. Gebeurtenissen uit het nu ‘in de wereld’ (the outside world) worden direct gekoppeld aan gerelateerde archiefcontent (de wereld van het archief). In AXES-HOME werden twee varianten uitgewerkt: één waarbij op de landingspagina van de applicatie een algemeen kenmerk van de specifieke dagen in de week (bijvoorbeeld ‘Dag van de architectuur’, ‘kinderboekenweek’ of ‘Landelijke fietsdag’) als zoekingang werd genomen om gerelateerde archiefcontent te tonen (zie Figuur 1), en één dat binnenkomende nieuws-feeds real-time vertaalt naar een zoekvraag om archiefmateriaal met een relatie tot de inhoud van de feed aan de gebruiker te presenteren (zie Figuur 2).

Figuur 3. Het leggen van koppelingen tussen een video fragment en andere video fragmenten in het archief

Figuur 3. Het leggen van koppelingen tussen een video fragment en andere video fragmenten in het archief

Meer informatie

- de website van het AXES project

- het AXES-HOME systeem uitproberen kan binnen de muren van het Nederlands Instituut voor Beeld & Geluid via Beeld & Geluid Labs

Deze blogpost is eerder verschenen op de blog van Roeland Ordelman